DeepSeek har bevist, at AI-træning ikke kræver de dyreste GPU'er som H100 I stedet kan virksomheder opnå høj ydeevne til lavere omkostninger med rekonditionerede NVIDIA A100, V100 eller H800 GPU'er.

Omkostningseffektiv AI med NVIDIA A100 og V100 GPU'er

Kunstig intelligens udvikler sig hurtigt, og virksomheder over hele verden søger måder at opbygge AI-infrastruktur uden at overskride budgettet. Succesen med DeepSeek, et kinesisk AI-firma, har vist, at avanceret AI ikke nødvendigvis kræver de nyeste eller dyreste GPU'er – det handler om at vælge den rigtige hardware til opgaven.

For eksempel blev ChatGPT trænet med NVIDIA’s V100 og A100 GPU'er, mens DeepSeek brugte ca. 2.000 NVIDIA H800 GPU'er – en model designet til Kina med reduceret chip-til-chip-båndbredde sammenlignet med den globale version, H100.

Selvom A100 og V100 er modeller fra tidligere generationer, er de stadig ekstremt kraftfulde til AI-træning og inferens. Dette viser et vigtigt skift: Virksomheder kan opnå stærk AI-ydeevne med omkostningseffektive alternativer som A100 og V100, i stedet for at investere i de nyeste og dyreste GPU'er.

Hvad er DeepSeek?

DeepSeek er et kinesisk AI-firma, der har tiltrukket global opmærksomhed ved at udvikle en AI-model, der potentielt kan konkurrere med OpenAI’s ChatGPT – men til markant lavere omkostninger. I modsætning til amerikanske AI-giganter, der investerer milliarder i infrastruktur, hævder DeepSeek at have trænet sin AI ved hjælp af kun 2.000 NVIDIA H800 GPU'er, hvilket beviser, at højtydende AI ikke nødvendigvis kræver den dyreste hardware.

Denne tilgang positionerer DeepSeek som et omkostningseffektivt alternativ inden for AI-udvikling og udfordrer den gængse opfattelse af, at avanceret AI kræver enorme finansielle investeringer.

Hvem ejer DeepSeek?

DeepSeek blev lanceret i juli 2023 af Liang Wenfeng, en kandidat fra Zhejiang University med baggrund i AI-drevne investeringsstrategier. Hans hedgefond High-Flyer finansierede projektet, og han ejer 84 % af virksomheden gennem to holdingselskaber.

DeepSeek’s fremkomst repræsenterer et skift i AI-udvikling og viser, at AI-modeller kan trænes effektivt uden milliardinvesteringer, hvilket potentielt ændrer måden, virksomheder investerer i AI.

Byg AI-servere billigere med rekonditionerede NVIDIA A100 GPU'er

Efterhånden som AI-efterspørgslen vokser, genovervejer virksomheder deres hardwarestrategier. I stedet for at bruge millioner på de nyeste GPU'er, vælger mange rekonditionerede NVIDIA A100 GPU'er for at skalere AI-infrastrukturen til en brøkdel af prisen.

Uden for Kina er A100 det bedste alternativ til H800, da den tilbyder samme AI-træningskapacitet men med bedre global tilgængelighed. Mens V100 stadig er et stærkt valg til inferens, giver A100 bedre effektivitet, skalerbarhed og hukommelsesbåndbredde til moderne AI-applikationer.

H100 er den mest kraftfulde mulighed, men A100 giver den bedste balance mellem pris og ydeevne for virksomheder, der ønsker at optimere deres AI-investeringer.

Hvorfor vælge rekonditionerede A100 GPU'er?

✔ Op til 70 % besparelse – Enterprise AI-ydeevne til lavere omkostninger

✔ Bæredygtig & effektiv – Forlæng GPU'ens levetid og reducer IT-udgifter

✔ Optimeret til AI – Ideel til deep learning og store sprogmodeller (LLM)

Lavere omkostninger, maksimal ydeevne

Den høje pris på ny hardware begrænser AI-udviklingen, men rekonditionerede A100 GPU'er leverer massiv processorkraft til deep learning, modeltræning og realtids-AI-applikationer – hvilket hjælper virksomheder med at forblive konkurrencedygtige.

Udover omkostningsbesparelser frigør rekonditionerede GPU'er kapital til AI-forskning, dataoptimering og softwareudvikling – hvilket accelererer innovation, samtidig med at den finansielle fleksibilitet bevares.

NVIDIA H100 er uden tvivl den mest kraftfulde GPU til AI-arbejdsbelastninger, men den er også markant dyrere. A100 derimod giver den bedste pris-til-ydeevne-ratio, hvilket gør den ideel for virksomheder, der har brug for højhastigheds AI-træning uden de høje omkostninger ved en H100-opgradering

Hvordan sammenlignes NVIDIA A100 med H800?

H800 er en Kina-specifik variant af H100, bygget med reduceret NVLink-båndbredde og lavere samlet ydeevne på grund af amerikanske eksportrestriktioner. Selvom H800 tilbyder stærke AI-kapaciteter, er den ikke tilgængelig uden for Kina, hvilket gør det nødvendigt for virksomheder at finde et alternativ.

For virksomheder uden for Kina er A100 det bedste alternativ til H800, da den leverer stærk AI-ydeevne og effektivitet. Dog er H100 stadig det bedste valg for dem, der har brug for den højeste AI-beregningskraft.

| Specifikation | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Arkitektur | Hopper | Hopper | Ampere |

| Process-teknologi | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| GPU-hukommelse | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Hukommelsesbåndbredde | Op til 3,35 TB/s (SXM) | ~1.9 TB/s (SXM) | Op til 2,0 TB/s (80GB-version) |

| NVLink-båndbredde | 900 GB/s | 400 GB/s | 600 GB/s |

| PCIe-generation | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Ydeevne | Højeste AI-træning & inferensydeevne | Reduceret ydeevne pga. lavere NVLink | Stærk ydeevne til AI-træning & HPC |

| Markedsadgang | Global (Enterprise AI, HPC) | Begrænset til Kina | Global |

| Bedste anvendelse | Store AI-modeller, LLM-træning, højtydende AI | Omkostningseffektiv AI til kinesiske virksomheder | AI-træning, deep learning, HPC-workloads |

Spar op til 70 % ved køb af en rekonditioneret NVIDIA A100 GPU fra Renewtech

NVIDIA A100 Tensor Core GPU er designet til AI-træning, deep learning og inferens. Den leverer høj-båndbredde ydeevne til krævende AI-arbejdsbelastninger til en brøkdel af prisen sammenlignet med nyere modeller.

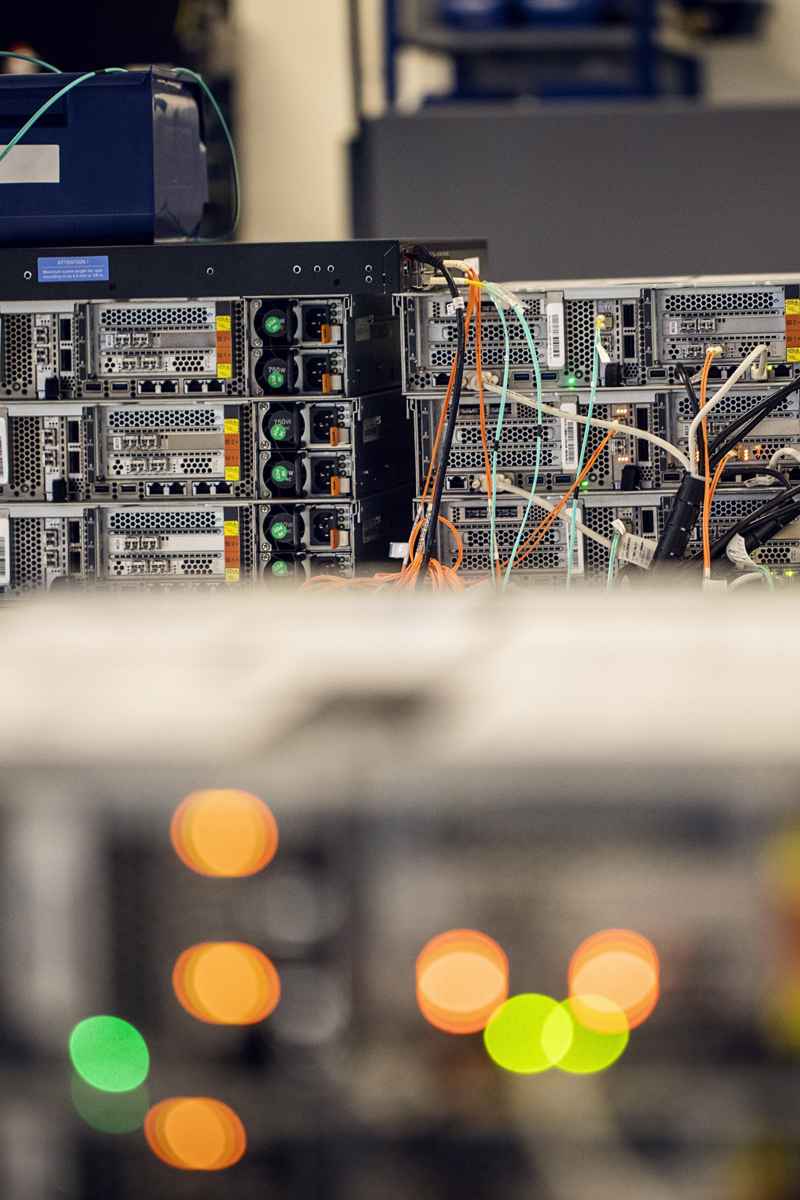

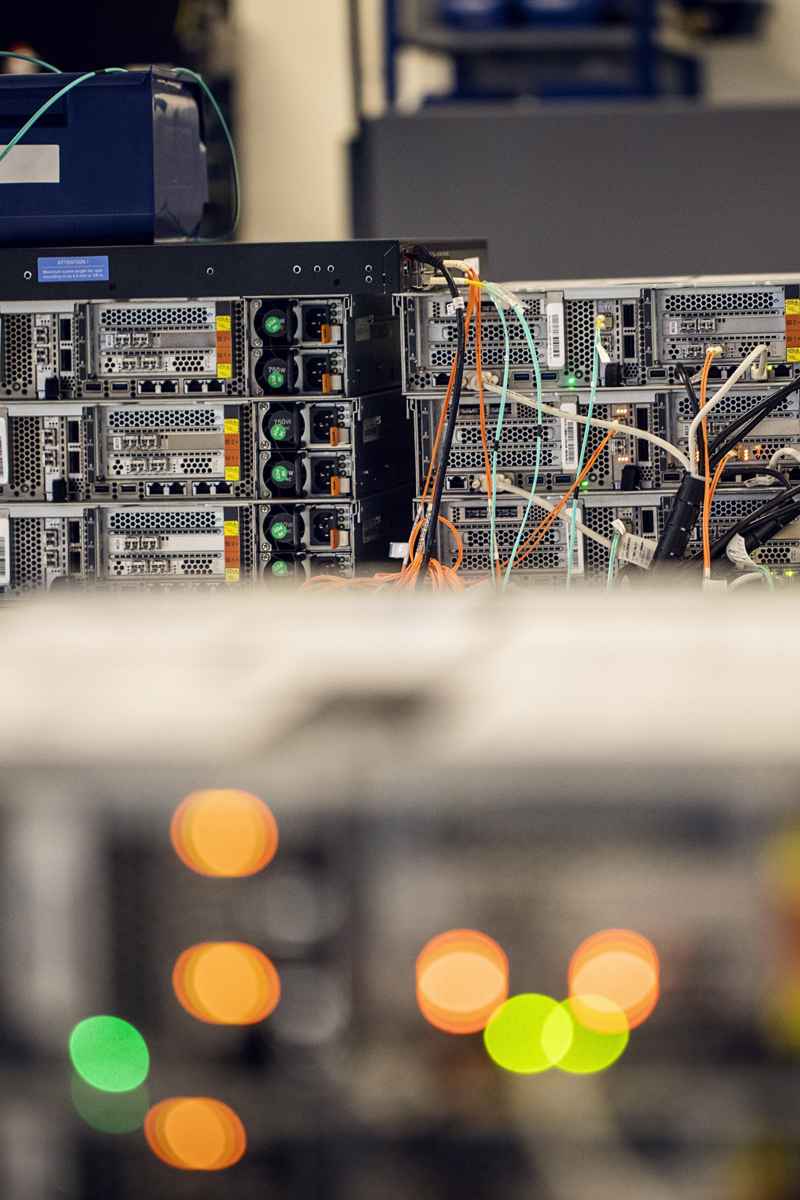

AI-servere, der understøtter NVIDIA A100

At vælge den rigtige AI-server er afgørende for skalerbarhed, effektivitet og omkostningseffektivitet. AI-arbejdsbelastninger – såsom deep learning, store sprogmodeller (LLMs) og realtidsinferens – kræver kraftig hardware for at maksimere ydeevnen uden unødvendige omkostninger.

For virksomheder, der ønsker at skalere AI økonomisk, giver rekonditionerede NVIDIA A100 GPU'er høj computerkraft til en brøkdel af prisen. For at gøre valget lettere har vi udvalgt to højtydende AI-servere, der fuldt ud understøtter NVIDIA A100 GPU'er – og leverer den perfekte balance mellem hastighed, pålidelighed og omkostningseffektivitet.

Hvorfor er det vigtigt at vælge den rigtige AI-server?

-

Optimerede arbejdsbelastninger – AI-træning, inferens og deep learning kræver højtydende GPU'er, hurtig hukommelse og PCIe-båndbredde for at sikre jævn drift.

-

Skalerbarhed & fremtidssikring – En velvalgt server gør det muligt at udvide AI-infrastrukturen problemfrit, efterhånden som behovene vokser.

-

Omkostningseffektivitet – Investering i den rigtige hardware maksimerer ROI og minimerer spildte ressourcer.

Med AI-servere drevet af NVIDIA A100 kan virksomheder opbygge AI-infrastruktur, der leverer stærk ydeevne, samtidig med at de holder sig inden for budgettet.

Supermicro SYS-4028GR-TRT vs. Dell PowerEdge R740 til AI

At vælge den rigtige AI-server er nøglen til at maksimere ydeevne og effektivitet. Både Supermicro SYS-4028GR-TRT og Dell PowerEdge R740 understøtter NVIDIA A100 GPU'er, men de er designet til forskellige AI-arbejdsbelastninger.

- Supermicro SYS-4028GR-TRT er bygget til deep learning i stor skala, da den understøtter op til 4 NVIDIA A100 GPU'er. Dette gør den til det bedste valg for virksomheder, der har brug for høj GPU-densitet.

- Dell PowerEdge R740, derimod, understøtter op til 2 NVIDIA A100 GPU'er, hvilket gør den til et mere omkostningseffektivt alternativ for virksomheder, der fokuserer på AI-inferens og mindre træningsmodeller.

Nedenfor er en side-om-side-sammenligning for at hjælpe dig med at vælge den AI-server, der passer bedst til din GPU-infrastruktur.

| Funktion | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| GPU-understøttelse | Op til 4x NVIDIA A100 PCIe – Optimeret til multi-GPU AI-workloads. | Op til 2x NVIDIA A100 PCIe – Designet til AI-acceleration med omkostningseffektivitet. |

| CPU-muligheder | Intel Xeon Scalable (2. gen) – Dual-socket support til højtydende AI. | Intel Xeon Scalable (2. gen) – Velbalanceret til inferens-workloads. |

| Hukommelseskapacitet | Op til 6TB DDR4 – Bygget til storskalige AI-modeller og deep learning. | Op til 3TB DDR4 – Understøtter AI-workloads, men med lavere skalerbarhed. |

| Lagringsmuligheder | Understøtter op til 24x 2,5” diske (HDD/SSD) – Designet til dataintensiv AI-træning. | Understøtter op til 16x 2,5” diske (HDD/SSD) – Tilstrækkelig til inferensapplikationer. |

| Netværk & tilslutning | Flere 10GbE & 25GbE muligheder, PCIe 4.0 til høj båndbredde for AI-dataflow. | Dobbelt 10GbE-porte, PCIe 4.0, velegnet til AI-inferens-effektivitet. |

| Udvidelse & skalerbarhed | Flere PCIe Gen 4-slots – Perfekt til multi-GPU opsætninger og fremtidig udvidelse. | Stærk PCIe 4.0 support – Velegnet til AI-workloads, men begrænset multi-GPU-skalerbarhed. |

| Køling & strømstyring | Optimeret til høj GPU-densitet – Avanceret køling til effektiv håndtering af flere A100'er. | Effektiv termisk styring – Strømbesparende køling til inferens-workloads. |

| Formfaktor & tæthed | 4U rackserver – Højere densitet, designet til AI-modeltræning i stor skala. | 2U rackserver – Pladsbesparende med moderat AI-accelerationskapacitet. |

| Anvendelsesområde | AI-modeltræning, deep learning og LLMs – Ideel til AI-forskning og produktion. | AI-inferens, omkostningseffektiv AI-udrulning – Optimeret til AI-drevne virksomheder, der ønsker at skalere omkostningseffektivt. |

Supermicro SYS-4028GR-TRT

En høj-densitets AI-server bygget til multi-GPU computing, Supermicro SYS-4028GR-TRT er designet til at maksimere NVIDIA A100’s ydeevne. Med rigeligt PCIe 4.0-båndbredde, robust energieffektivitet og avanceret køling sikrer den stabil AI-træning og inferens.

- Optimeret til AI og maskinlæring – Understøtter multi-GPU-konfigurationer, hvilket gør den ideel til deep learning og store AI-modeller.

- Enterprise-klassens ydeevne – Høj båndbredde og effektiv køling til krævende AI-beregninger.

Få AI-ydeevne med Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

En alsidig enterprise-server, Dell PowerEdge R740 tilbyder en skalerbar løsning til AI og HPC workloads. Med understøttelse af flere NVIDIA A100 GPU'er tilbyder den høj hukommelseskapacitet, effektiv køling og stærk PCIe 4.0-ydeevne.

- Skalerbar AI-infrastruktur – Kan konfigureres til AI-modeltræning, inferens og højtydende computing.

- Omkostningseffektiv ydeevne – En rekonditioneret R740 gør det muligt for virksomheder at integrere AI uden store omkostninger, så de kan opretholde høj ydeevne uden at overskride budgettet.

Få AI-ydeevne med PowerEdge R740

Maksimer AI-ydeevnen med H100-servere

For virksomheder, der har brug for mere computerkraft til avancerede AI-applikationer, tilbyder en opgradering til NVIDIA H100 GPU'er en af de højeste AI-ydeevner, der findes. Uanset om du arbejder med deep learning i stor skala, LLM-træning eller realtids-AI-inferens, er den rigtige serverinfrastruktur afgørende.

I modsætning til tidligere GPU-generationer leverer H100 GPU'er:

- Uovertruffen AI-acceleration – Hurtigere matrixoperationer, øget NVLink-båndbredde og højere hukommelseseffektivitet.

- Fremtidssikret skalerbarhed – Optimeret til AI-træning, HPC og enterprise workloads med PCIe 5.0-understøttelse.

Virksomheder, der håndterer store AI-datasæt, storskalasimuleringer eller avanceret modeltilpasning, vil drage mest fordel af at implementere AI-servere, der er klar til H100. Disse servere er bygget til at håndtere høj-båndbredde AI-workloads, hvilket sikrer hurtigere træningstider, realtidsinferens og problemfri skalerbarhed til fremtidige AI-projekter.

Med rekonditionerede AI-servere kan virksomheder integrere H100 GPU'er til en lavere pris og undgå unødvendige infrastrukturudgifter, samtidig med at de stadig nyder godt af AI-ydeevne i topklasse.

Dell R750 vs. Lenovo SR650 V2 til AI

At vælge den rigtige server til AI og deep learning er afgørende for at maksimere ydeevne og effektivitet. Både Dell PowerEdge R750 og Lenovo ThinkSystem SR650 V2 understøtter NVIDIA H100 GPU'er, men de imødekommer forskellige behov.

- Dell R750 tilbyder flere PCIe-slots for bedre udvidelse.

- Lenovo SR650 V2 fokuserer på skalerbarhed og omkostningseffektivitet.

Nedenfor er en sammenligning for at hjælpe dig med at finde den bedste løsning til din AI-infrastruktur.

| Funktion | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| GPU-understøttelse | Op til 2x NVIDIA H100 PCIe | Op til 2x NVIDIA H100 PCIe |

| CPU-muligheder | Intel Xeon Scalable (3. gen) | Intel Xeon Scalable (3. gen) |

| Hukommelseskapacitet | Understøtter op til 8TB DDR4/DDR5 | Understøtter op til 8TB DDR4/DDR5 |

| Lagringsmuligheder | Understøtter op til 28x 2,5” drev (HDD/SSD) | Understøtter op til 20x 2,5” drev (HDD/SSD) |

| Netværk & tilslutning | Dobbelt 10GbE-porte, PCIe Gen 5-slots til fremtidssikring | Dobbelt 10GbE-porte, PCIe Gen 4, stærk energieffektivitet |

| Udvidelse & skalerbarhed | Flere PCIe Gen 4/5-slots – Ideel til multi-GPU-konfigurationer og AI-acceleratorer som NVIDIA NVLink Bridges | Energieffektiv design med Lenovo Neptune™-køling – Fokus på omkostningsbesparelser uden at gå på kompromis med AI-ydeevnen |

| Køling & strømstyring | Optimeret til AI-workloads med høj energiforbrug – Indeholder Dell Smart Cooling til højtydende GPU'er som H100 | Effektiv køling & strømhåndtering – Bruger Lenovo XClarity Controller til at optimere strømforbruget i AI-applikationer |

| Formfaktor & tæthed | 2U Rack Server – Høj tæthed til enterprise AI | 2U Rack Server – Designet til skalerbarhed og modulær AI-udvidelse |

| Anvendelsesområde | Enterprise AI & højtydende computing | Skalerbar AI-infrastruktur & omkostningseffektiv AI-udrulning |

Dell PowerEdge R750

En højtydende enterprise-server designet til AI-acceleration, PowerEdge R750 understøtter op til to NVIDIA H100 PCIe GPU'er. Med PCIe Gen 4-kanaler og højhastighedsnetværk leverer den den nødvendige kraft til AI-modeltræning, inferens og dataintensive applikationer.

- Optimeret til AI & maskinlæring – Understøtter dual-GPU-konfigurationer, der accelererer AI-workloads og realtidsinferens.

- Enterprise-klassens ydeevne – Leverer høj båndbredde og effektiv strømhåndtering, hvilket gør den til et stærkt valg for AI-drevne virksomheder og organisationer.

Få AI-ydeevne med PowerEdge R750

Lenovo ThinkSystem SR650 V2

Denne alsidige rackserver er bygget til virksomheder, der har brug for skalerbarhed. Den understøtter full-length, full-height og double-wide GPU'er, herunder NVIDIA H100, og er optimeret til AI-workloads, der kræver hurtig behandling, deep learning og big data-analyse.

- Fremtidssikret AI-infrastruktur – Designet til skalerbare AI-implementeringer, hvilket sikrer problemfri udvidelse, efterhånden som AI-behovet vokser.

- Omkostningseffektiv ydeevne – En rekonditioneret SR650 V2 giver virksomheder mulighed for at integrere AI-infrastruktur til en væsentligt lavere pris, hvilket gør højtydende AI mere tilgængelig.

Få AI-ydeevne med SR650 V2

Har du brug for hjælp til at vælge den rette AI-server?

At vælge den rigtige AI-server behøver ikke at være svært. Uanset om du har brug for rekonditionerede NVIDIA A100 eller H100 GPU'er eller ekspertrådgivning, er vi her for at hjælpe.

Hvordan vi kan hjælpe:

✔ Personlig AI-servervejledning – Find den bedste løsning til AI-modeltræning eller deep learning

✔ Lager- & tilgængelighedsnotifikationer – Bliv opdateret, når rekonditionerede A100- eller H100-GPU'er er tilbage på lager eller få alternative løsninger

Spar op til 70 % på AI-infrastruktur – uden at gå på kompromis med ydeevnen!

Har du brug for omkostningseffektiv AI-træning med A100/V100 eller højtydende H100 GPU'er? Kontakt os nu for ekspertrådgivning, priser og tilgængelighed!